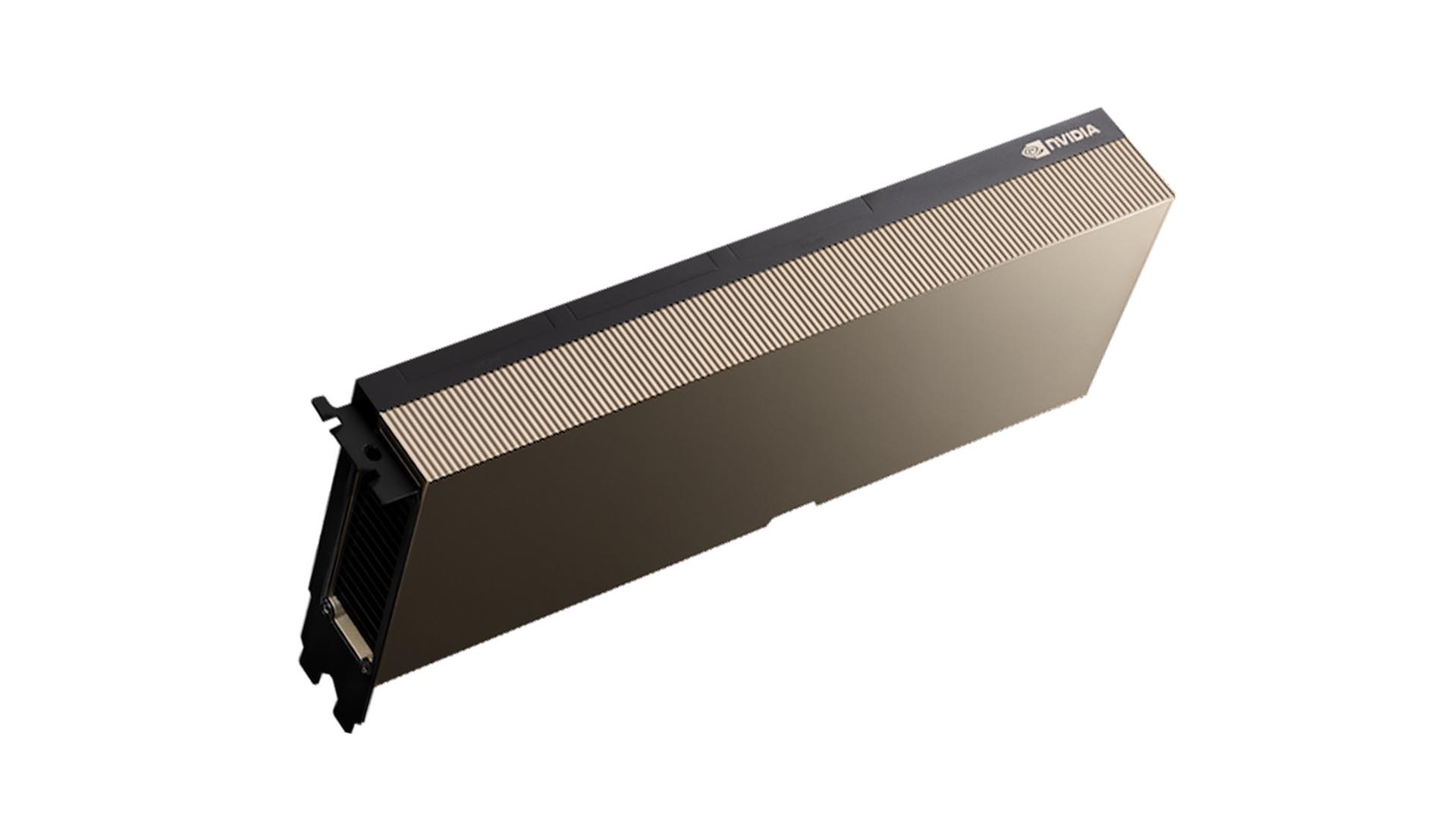

大家對於 Ampere GPU 架構用在 GeForce 顯示卡的期待程度遠高於運算卡,但 NVIDIA 至今仍未對 GeForce 顯示卡部分的 Ampere GPU 架構有太多資訊,而稍早他們在 ISC 2020 活動中公佈了採用 Ampere GPU 架構的 A100 PCIe 運算卡。

同樣為 GA100 的 A100 運算卡,但與早前 SXM4 版本的 A100 不同;NVIDIA 這次公佈的 PCIe 版本的 A100 運算卡 TDP 只有 250W,相較於 SXM4 版本的 400W,整個功耗降低了 150W。

就規格來說,不管是 SXM4 版本,或者是 PCIe 版本的 A100 在規格的差異並沒有太大,其中一個差異只有在 NVLink 部分。SXM4 和 PCIe 的 A100 均為 NVLink 3 規格,但 SXM4 版本的 NVLink 3 頻寬可以達到 600GB/s(12 Links),而 PCIe 版本則只有 300GB/s(6 Links)。

PCIe 版本的 A100 與 SMX4 版本的效能差異在 10% 左右。

NVLink 通道數差異以及 GPU 基本時脈差異可能是 PCIe 版本的 A100 功耗可以下調至 250W 的其中原因;當然,單卡(被動式散熱)在 Server 內的最大解熱能力為 250W,若超過這個數字,有相當大的可能無法解熱而讓運算能力下滑。

| P100 | V100 | A100 | |

|---|---|---|---|

| Architecture | Pascal | Volta | Ampere |

| Process Node | TSMC 16nm FinFET | TSMC 12nm FFN | TSMC 7N |

| GPU | GP100 | GV100 | A100 |

| Transistor Count | 15.3B | 21.1B | 54.2B |

| TDP | 300W | 300 / 350W | 400W |

| FP32 CUDA Cores | 3584 | 5120 | 6912 |

| Boost Clock | 1480MHz | 1530MHz | ~ 1410MHz |

| Memory Clock | 1.4Gbps HBM2 | 1.75Gbps HBM2 | 2.4Gbps HBM2E |

| Memory Bus Width | 4096 bit | 4096 bit | 5120 bit |

| Memory Bandwidth | 720GB/s | 900GB/s | 1.6TB/s |

| VRAM | 16GB | 16GB / 32GB | 40GB |

| Single Precision | 10.6 TFLOPs | 15.7 TFLOPs | 19.5 TFLOPs |

| Double Precision | 5.3 TFLOPs (1/2 FP32 rate) | 7.8 TFLOPs (1/2 FP32 rate) | 9.7 TFLOPs (1/2 FP32 rate) |

| INT8 Tensor | - | - | 624 TOPs |

| FP16 Tensor | - | 125 TFLOPs | 312 TFLOPs |

| TF32 Tensor | - | - | 156 TFLOPs |

| Interconnect | NVLInk 1 4 Links(160GB/s) | NVLink 2 6 Links(300GB/s) | NVLink 3 12 Links(600GB/s) |

| Interface | SXM | SMX2 / SXM3 | SXM4 |

另一方面,我們也從規格中確定 NVIDIA 會從 Ampere 架構開始導入 PCIe Gen4 規格,以這樣的情況來說,NVIDIA 之後在 Ampere 架構的 GeForce 顯示卡展示機有非常大的可能從 Intel 轉換至 AMD 平台,畢竟 Intel 現有平台仍未支援 PCIe Gen4。

擁有 542 億電晶體數量的 GA100 採用 TSMC 7nm 製程,最大記憶體容量為 40GB HBM2e,並且擁有 6912 CUDA Cores(FP32)。